不知道大家还记得 “一键脱衣 AI” DeepNude 和 “一键换脸”的 Deepfake吗?

最近又一一款新的软件卷土重来了!

早在去年有就在国外技术圈和媒体界火了好几天,原来是一款APP 可以使用AI把照片去掉衣服变成裸照,合成逼真图像的消息,让国外掀起了巨浪。深度造软件发布仅几个小时便因访问请求过大迅速宕机,而其原因是它可以一键脱掉女性衣服,制造大量色情图片。我们回顾一下。

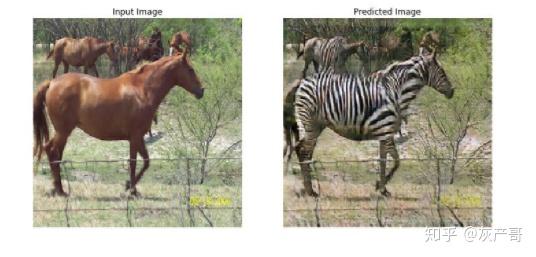

1 .Deepfake 换脸技术

说起这类技术,大家能想起在2017 年,伪造逼真图像的 Deepfake 技术利用其将女性图片嫁接至色情图像内容引起很非议,用它恶意伪造的图像开始大规模在互联网上流传,也给人们辨别图像真假带来了困扰。

事实上,Deepfake 这是以色列一家科技公司利用人工智能(AI)换脸技术合成而来,这一技术也被称为“深度伪造”(deepfake)。

更遭受争议的deepfake例子例如最近走红网络的一键生成裸照软件DeepNude,只要输入一张完整的女性图片就可自动生成相应的裸照,由于广泛传播而造成了预料之外的后果,开发者最终将APP下架。

这几个例子背后都用到了深度伪造技术,即一种利用AI程序和深度学习算法实现视、音频模拟和伪造的技术,投入深度学习的内容库越大,合成的视音频真实性越高,甚至可以达到以假乱真的程度。

深度伪造技术不仅能实现换脸(face swap),更可以通过深度学习模拟真人声音、创造出现实不存在的人物肖像。利用该技术,可以以视频这一较为可信的方式让某人说不曾说过的话,做不曾做的事,达到混淆观众的目的。具备极高欺骗性的深度伪造也引发诸多争议,例如杨幂换脸,AI软件自动生成裸照,奥巴马、普京等政治人物的深度伪造视频等等,给个人和社会带来风险挑战。

如果说 Deepfake 对非技术人员有使用门槛的话,现在,一种比 Deepfake 更快、更易用,无门槛的“变体”应用出现了,它叫 DeepNude。

2. 比 Deepfake 更快、更易用 DeepNude

据 Motherboard 报道, DeepNude APP 使用神经网络技术能将女性图片中的衣物消除,让照片看上去就像是真实裸照,尤其裸露皮肤面积越大,处理效果越好。其背后的团队已经发布了 Windows 和 Linux 系统版本。

DeepNude 处理照片的范围目前仅限于女性照片,可以处理任何的东西照片。

不过很快,在媒体报道后,迫于舆论压力,使用 AI 创建女性假裸照的 DeepNude 就被其团队关闭,其官网已无法打开。DeepNude 团队在其推文中表示他们大大低估了对该项目的受欢迎程度以及人们滥用它的可能性。

DeepNude 将不再对外发售,之间老的版本也将不会发布。DeepNude还要求不要在线共享该软件,这将违反该应用的服务条款。但他们同时承认,“(该应用)肯定会有一些副本”发布出来。

3.神经网络深度伪造

目前,DeepNude 只需点击一下即可在 30 秒内生成一张逼真的伪造裸照,未来这个时间还可以提速。相比之下,Deepfake 技术虽然在快速升级,但目前也至少需要数小时来生成可信的人脸伪造照片,而使用 Photoshop 软件来将一张图片 P 成逼真裸照也需要好几分钟。

处理后:

所以,对于对一些女性带来了担忧和困扰。

DeepNude 宣称,做该软件是出于对技术的热爱和好奇心,作者称他们并不是侵犯隐私,并指出 DeepNude 也不会自动上传图像,只处理生成用户想做的图片。

与 Deepfake 软件所造成的负反馈一样,其最大的负面影响是这些照片可能会被用来骚扰女性,比如将女明星伪造成色情影片的女主角。

假如有人把你女友的照片做成裸照发给你,你根本无法判别,假如有一天你女友真的做了什么不好的事情,也可以把锅甩给DeepNud。

该软件作者说:即便他不先做的话,别人也会很快制作像 DeepNude 这样的软件,因为技术门槛并不高。

很多人对 DeepNude 团队的言论表达进行了批评。网友觉得这计软件非常可怕,侵犯了人们的隐私,因为任何人都可能成为这项技术的受害者,那这项技术不应该向公众开放?

后续 DeepNude称:”如果发现该软件被滥用,他的团队肯定会放弃它。“

后续在舆论的压力下关闭其网站和APP。

DeepNude 盯上了 “可能认识的人”

最近DeepNude 盯上了 “可能认识的人”。

一项来来自美国阿姆斯特丹的网络安全公司 Sensity的调查报告显示,他们调查发现,截至 7 月底,Telegram 平台七个主要频道均在使用 DeepNude 软件。是一家专注于所谓的 “视觉威胁情报”的公司,尤其是那些深度造假视频的传播。

一款叫Telegram的软件吸引了全球 103,585 名用户,其中用户最多的频道有 45,615 人。这些用户大部分聚集在俄罗斯及东欧周边地区。据了解,Telegra软件爆火的原因有三点。一是操作非常方便,只需要惹任意一张照片,上传至软件后,几秒就可以自动生成裸照,不需要任何技术知识或者专门的硬件支持。二是对外开放免费使用。不过带有水印,如果用户支付 1.28 美元就可以获得无水印图片,非常逼真。

三是可以得到熟悉的人的裸照(用途未知)。Deepfake和 DeepNude伪造色情视频已经屡见不鲜,主要以为名人为目标。但根据一项民意调查显示,大多数用户对 “现实生活中认识的女性” 更感兴趣,占比达到了 63%。

目前,Sensity 公司已经对外披露了相关调查数据,相关执法部门也对此展开了调查。而至此,为何允许该色情软件出现在社交平台中,Telegram 一直未给出公开答复。

技术虽无罪,但乱用就有罪

无论如何,利用神经网络技术,深度学习计算机视觉技术,类似的深度伪造图像只会更快速易于制作,并且难以检测,但如何防止滥用人们的图像,目前鲜有良好的应对方法。但不管是出于猎奇,还对技术研发的准确,这这种技术确实是滥用 AI 技术产生了恶劣的影响。

不仅是 DeepNude,所有 Deepfake 软件均是如此。借助互联网传播的便利,很容易对受害者造成名誉的影响,即使未来使用 ,

我希望此类该软件使用在正途上,不要作为不发份子的伤害大家的工具。

最后,物以类聚,人以群分,接触更优秀的人也可以让你成为同样的人,欢迎关注官方公号:灰产圈

灰产圈:培养你的发散性思维 解密互联网骗局、实战揭秘互联网灰产案例、网赚偏门项目解析、分享网络营销引流方案。深挖内幕、曝光各类套路。

?“一键脱衣”,又卷土重来了!

电话:13988888888

传 真:海南省海口市

手 机:0898-66889888

邮 箱:88889999

地 址:/public/upload/system/2018/07/28/2091301cca30ff8c6fd3ecd09c8d4b02.jpg